Overfitting และ Underfitting

Overfitting และ Underfitting เป็นข้อผิดพลาดในการสร้าง Deep learning ที่อาจเกิดขึ้นได้จากการทำ classification

Underfitting คือ การที่โมเดลของเราไม่สามารถทำงานได้ จากการที่ไม่สามารถจับแนวโน้มของข้อมูลได้ อันเนื่องมากจากโมเดลเราไม่เหมาะสมหรือข้อมูลมีจำนวนน้อยไป กรณีนี้โมเดลมีค่าความเอนเอียงสูง (high bias)

ตัวอย่างสถานการณ์

หากเรานำชุดข้อมูลที่ train มาลองจะได้ค่าความแม่นยำต่ำ และเมื่อนำชุดข้อมูล test มาวัดผลจะได้ค่าความแม่นยำต่ำเหมือนกัน

การหลีกเลี่ยงสามารถทำได้โดยเพิ่มข้อมูลมากขึ้น และ ลดคุณสมบัติ (features) จากการเลือกคุณสมบัติ (feature selection)

Overfitting คือ การที่โมเดลตอบสนองต่อการรบกวน (noise) จำนวนมาก จนเริ่มเรียนจากการรบกวนและรายละเอียดของข้อมูลที่ไม่ถูกต้อง แล้วโมเดลของเราจะไม่เหมาะสมสำหรับการสามารถทำนายข้อมูล เช่น ทำนายข้อมูลที่ไม่เคยมีอย่างผิดพลาดกว่าที่คาดจะเป็นมาก (ล้มเหลวที่จะทำนายข้อมูลได้ถูกต้อง) เพราะมีรายละเอียดและการรบกวนมากเกินไป กรณีนี้โมเดลมีค่าค่าความแปรปรวนของข้อมูลสูง (high variance)

ตัวอย่างสถานการณ์

สมมติ โมเดลของเรา train แล้วเอาชุดข้อมูลที่ train มาวัดผล ได้ความแม่นยำถึง 99% แต่เมื่อเรานำข้อมูลที่ไม่เจอปรากฎในชุดข้อมูลที่ train คือ ชุดข้อมูล test มาวัดผล กลับไปแค่ 60% นี่คือ Overfitting

Underfitting คือ การที่โมเดลของเราไม่สามารถทำงานได้ จากการที่ไม่สามารถจับแนวโน้มของข้อมูลได้ อันเนื่องมากจากโมเดลเราไม่เหมาะสมหรือข้อมูลมีจำนวนน้อยไป กรณีนี้โมเดลมีค่าความเอนเอียงสูง (high bias)

ตัวอย่างสถานการณ์

หากเรานำชุดข้อมูลที่ train มาลองจะได้ค่าความแม่นยำต่ำ และเมื่อนำชุดข้อมูล test มาวัดผลจะได้ค่าความแม่นยำต่ำเหมือนกัน

การหลีกเลี่ยงสามารถทำได้โดยเพิ่มข้อมูลมากขึ้น และ ลดคุณสมบัติ (features) จากการเลือกคุณสมบัติ (feature selection)

Overfitting คือ การที่โมเดลตอบสนองต่อการรบกวน (noise) จำนวนมาก จนเริ่มเรียนจากการรบกวนและรายละเอียดของข้อมูลที่ไม่ถูกต้อง แล้วโมเดลของเราจะไม่เหมาะสมสำหรับการสามารถทำนายข้อมูล เช่น ทำนายข้อมูลที่ไม่เคยมีอย่างผิดพลาดกว่าที่คาดจะเป็นมาก (ล้มเหลวที่จะทำนายข้อมูลได้ถูกต้อง) เพราะมีรายละเอียดและการรบกวนมากเกินไป กรณีนี้โมเดลมีค่าค่าความแปรปรวนของข้อมูลสูง (high variance)

ตัวอย่างสถานการณ์

สมมติ โมเดลของเรา train แล้วเอาชุดข้อมูลที่ train มาวัดผล ได้ความแม่นยำถึง 99% แต่เมื่อเรานำข้อมูลที่ไม่เจอปรากฎในชุดข้อมูลที่ train คือ ชุดข้อมูล test มาวัดผล กลับไปแค่ 60% นี่คือ Overfitting

|

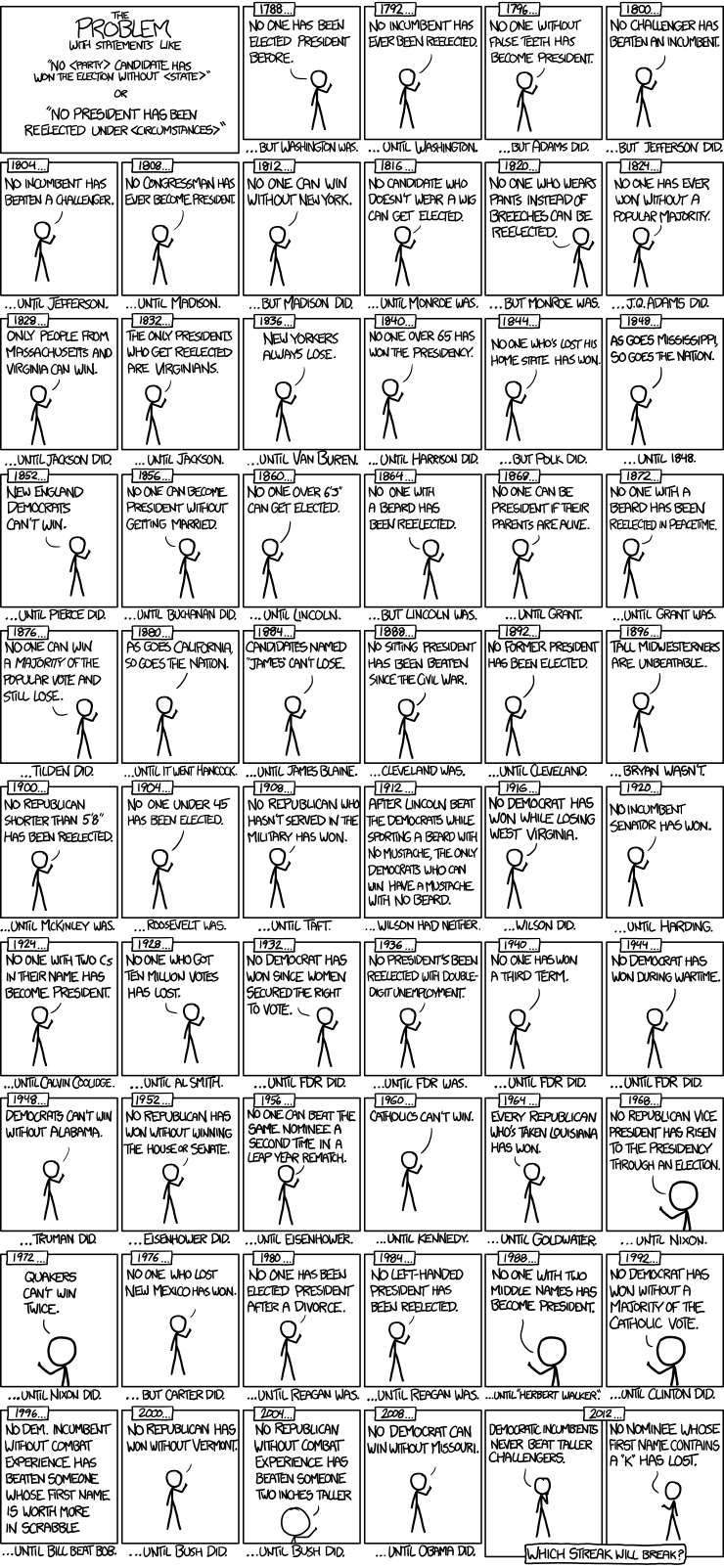

| Cr. https://xkcd.com/1122/ |

ความคิดเห็น

แสดงความคิดเห็น